AI數位詐騙以假亂真 警方宣導銀髮族強化科技識詐能力

AI數位詐騙以假亂真 警方宣導銀髮族強化科技識詐能力

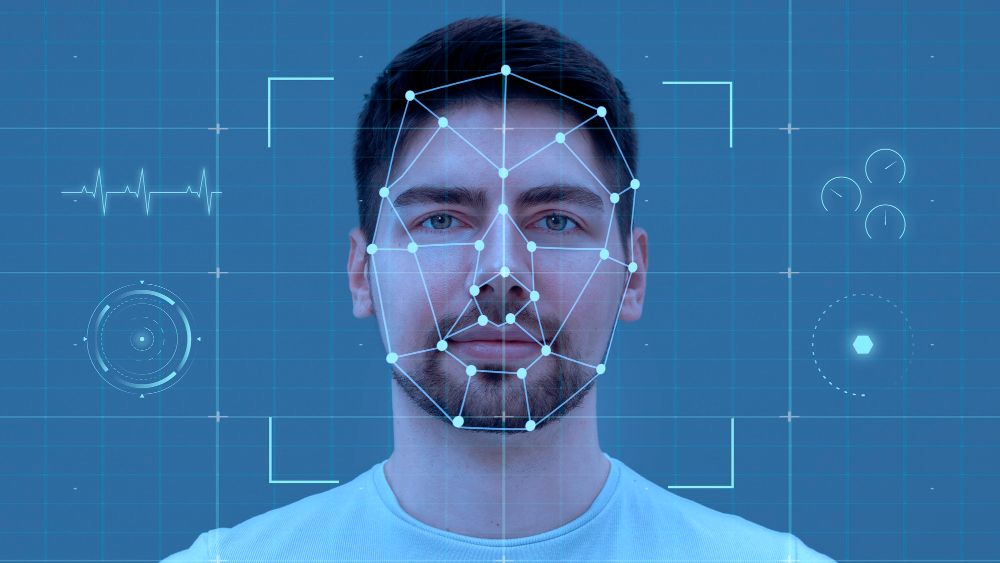

隨著人工智慧(AI)技術進步, 利用AI語音生成服務、深偽等技術,可以製造出逼真的虛假影像和聲音,容易讓民眾誤以為是被害者本人、檢警或名人而上當受騙,警方也提醒小技巧幫助民眾分辨,提升識詐能力。

愛長照編輯團隊

2024/04/24

瀏覽數 5,315

文/愛長照編輯團隊

現代人依賴科技產品的程度越來越高,為提升民眾數位能力,臺北市政府資訊局於光能區民活動中心舉辦「市民免費資訊課程」,臺北市政府警察局大同分局受邀至現場針對銀髮族數位課程進行防制詐騙宣導,以強化科技識詐能力。

隨著人工智慧(Artificial Intelligence, AI)技術進步, 利用AI語音生成服務技術,只需得到某人的錄音檔案,甚至只要三秒鐘的聲音檔,就可以合成模仿相似的情緒基調和聲音,並生成以假亂真的模擬聲,利用這個技術假冒親屬,進行詐騙,更易使被害人上鉤。

另外換臉(Deepfake)深偽技術,可以製造出逼真的虛假影像和聲音,仿真度極高,甚至連名人、明星照片也有遭偽造案例,很容易讓民眾誤以為偽冒者是被害者本人、檢警或名人,而上當受騙。

針對AI技術,大同分局員警教導與會民眾破解之道:在AI深偽的影像中,人的側臉、脖子等部位,現今軟體不會偵測分析及套用到,因此側面影像會產生模糊狀,臉部跟脖子也會產生色差。

所以如果忽然有親友、同事要求視訊,或是生活中未見過的人、自稱檢警的公務人員視訊,且在通話中要求民眾匯錢時,可以要求對方轉頭、變換姿勢、在臉前揮手,就可以藉由影像破綻分辨。

大同警籲請大家接收一切消息來源時,還是秉持3C原則,冷靜(Calm down)、查證(Check it out)及撥165(Call 165)就不會輕易被騙!

繼續閱讀:

1. 如何避免高齡失智長輩,成為詐騙集團眼中的肥羊?

2. 家中長輩獨居又少與人互動,如何預防被詐騙集團騙光老本?

.jpg)